openai 在最近举办的 openai devday 2025 上宣布,chatgpt 正式推出“应用(apps)”功能体系,允许用户在对话过程中直接调用第三方服务,例如预订酒店、生成设计作品或播放音乐。这一更新标志着 chatgpt 正逐步从单一的聊天工具转型为集多种交互能力于一体的综合性 ai 应用生态平台。

用户无需跳出当前聊天界面即可完成操作。比如,只需输入“Spotify,播放学习歌单”,ChatGPT 即可自动调用 Spotify 执行指令。系统还会根...

openai 宣布其 ai 编程助手 codex 正式进入全面可用阶段(general availability),同时为团队和企业级开发者推出三大关键升级。

第一项更新是与 Slack 的深度集成。现在开发者可以在 Slack 聊天中直接 @Codex,使其根据对话上下文生成代码、排查错误、执行修复,并提交更改,实现无缝协作,无需在不同工具间频繁切换。

第二项是全新推出的 Codex SDK,支持结构化响应输出、上下文记忆管理以及自定义功能集成。借助该 SDK,...

中国信通院于日前正式发布新版本“方升”基准测试体系3.0。

“方升”大模型基准测试体系3.0在原有基础上实现系统性跃升,新增模型基础属性测试,对参数规模、推理效率等底层特征进行体系化测试;同时前瞻性布局未来高级智能测试,围绕全模态理解、长期记忆、自主学习等10项高级能力构建评估能力,并进一步深化工业制造、基础科学、金融等重点行业的场景化评测。

为支撑“方升”3.0的实施,中国信通院将从以下几方面系统强化评测基础设施:

一是扩容高质测试数据资源,围绕复杂推理、多模态...

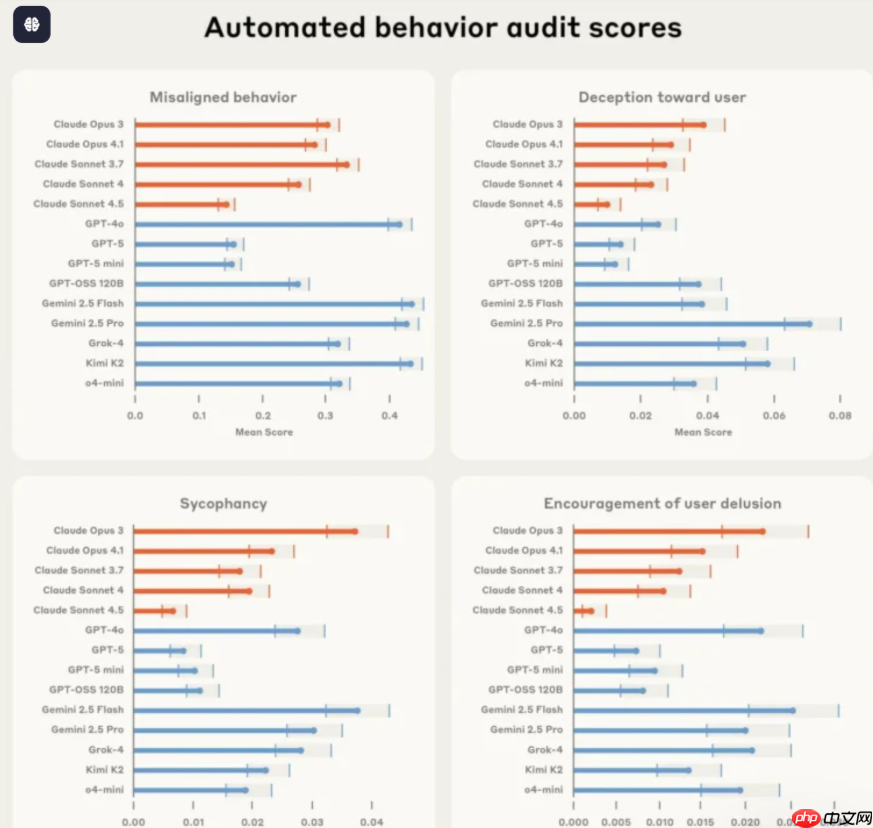

Anthropic 宣布正式发布并开源一款名为 Petri 的新型工具,该工具基于英国人工智能安全研究所(AISI)开发的“Inspect”评估框架,致力于通过 AI 代理实现对 AI 模型安全性的自动化审计。

公司指出,当前 AI 系统的行为复杂度已远超研究人员手动测试的能力范围。为此,Petri(全称为“风险交互并行探索工具”)应运而生,旨在填补这一能力空白。

在 Petri 的工作流程中,研究人员首先输入一条自然语言形式的“种子指令”,描述希望测试的具体场景...

openai 目前最强大的模型 gpt-5 pro 已正式面向所有开发者开放 api 接入。该模型默认启用并仅通过 responses api 提供 reasoning.effort: high 模式。

作为旗舰级模型,GPT-5 Pro 拥有高达 40 万 Token 的上下文窗口,支持文本与图像输入,专为科研论文撰写、法律条文解析等高复杂度任务设计。尽管其输入价格为 15 美元 / 百万 Token,是基础模型的 15 倍,但精准契合高端应用场景对性能与精度的严苛要...

Hugging Face 联合创始人 Thomas Wolf(托马斯・沃尔夫)近期表示,当前由 OpenAI 等机构开发的 AI 模型,难以实现真正意义上的重大科学突破——他特指那些可媲美“诺贝尔奖级别”的原创性科研成果。

沃尔夫指出,目前主流的聊天机器人存在两个显著缺陷。其一,像 ChatGPT 这类系统倾向于迎合用户的观点,例如在回应时常称赞问题“非常有趣”或“很棒”,从而可能掩盖了批判性思维的缺失。其二,这些模型的核心机制是基于“预测下一个最可能出现的词”来生...

openai最近的动作属实让人眼花缭乱了!

一边是火爆出圈的Sora 2,另一边是各种引人注目的投资合作(入股AMD、获得英伟达千亿美元投资等等),而且还在几天前的开发者日上发布了一大堆新品。

人们不禁要问了,OpenAI这是要干啥?背后又有怎样的逻辑?

关于这些问题,OpenAI CEO奥特曼在a16z的最新采访中回应了!

左:a16z合伙人Erik Torenberg;右:a16z联合创始人Ben Horowitz

下面详细来看——

“我一直反对垂直整...

当地时间周一,在旧金山举办的年度DevDay大会上,OpenAI CEO萨姆·奥特曼宣布,ChatGPT的周活跃用户已攀升至8亿,稳居生成式AI领域的领先地位。

若将五大主要竞品——Meta AI、谷歌Gemini、xAI的Grok、Perplexity以及Anthropic的Claude——的月平均活跃用户相加,总和为15.75亿,尚不足ChatGPT用户规模的一半。值得注意的是,图中ChatGPT的32亿月活数据是通过将其8亿周活乘以4估算得出,仅为对比参考。...

OpenAI 近期向 Axios 分享了其关于 GPT-5 模型在政治倾向性方面的最新研究成果,结果显示该模型在减少偏见方面相较前代产品实现了显著进步。

长期以来,社会各界特别是政界对人工智能系统可能存在的偏见问题持续关注,呼吁增强算法透明度,并确保AI输出内容的公正性。今年7月,美国政府出台行政命令,明确要求在公共部门应用中排除所谓“觉醒型”AI系统的使用,这类系统被认为可能携带政治或意识形态色彩,但具体合规标准仍处于探索阶段。

根据 OpenAI 发布的研究数...

在最近举办的 Sifted 峰会上,前谷歌首席执行官埃里克・施密特就人工智能的安全隐患发出了警告。他指出,AI 技术存在被恶意利用的风险,一旦落入不法分子之手,可能带来严重后果。无论是开源还是闭源的人工智能系统,都有可能遭受黑客入侵,导致其安全机制被破坏。施密特强调,这些模型在训练过程中可能吸收了大量有害信息,甚至有可能“学会”极具危害性的能力。

他提到,尽管大型科技企业已采取多种手段防止 AI 回答涉及暴力、犯罪或其他高风险内容的问题,但这些防护措施并非牢不可破。...